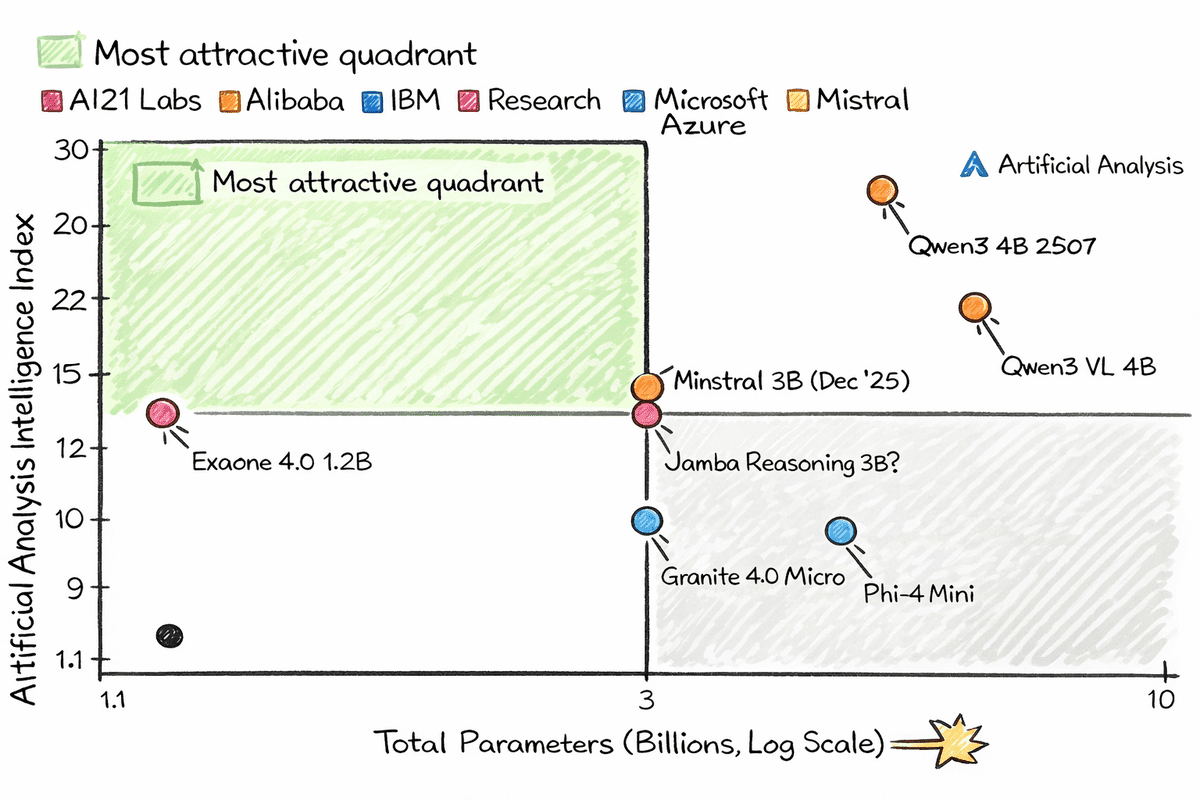

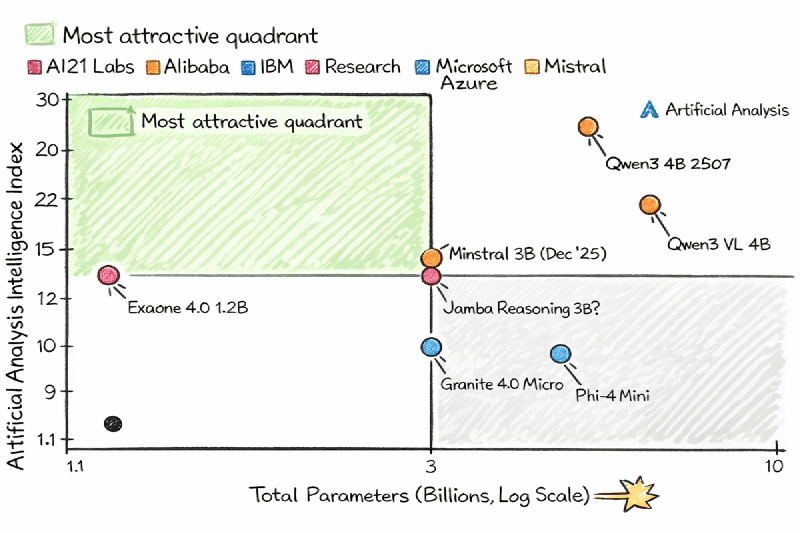

🍓 7 Modelos de IA que Caben en una Raspberry Pi

Gracias a la cuantización y las arquitecturas modernas, la IA ya no requiere servidores costosos. Estos 7 modelos de 1 a 4B parámetros demuestran que pequeño no significa débil. Solo necesitás llama.cpp y el modelo cuantizado desde Hugging Face.

🤖 Los modelos:

- 🥇 Qwen3 4B 2507 — Razonamiento, código, tool calling y 256K tokens de contexto. El más recomendado.

- 👁️ Qwen3 VL 4B — Versión multimodal con visión: imágenes, video y texto largo. Puede operar interfaces como agente.

- 🌍 EXAONE 4.0 1.2B — Solo 1.2B params, modo de razonamiento y soporte para español, inglés y coreano.

- 🔧 Ministral 3B — De Mistral AI, con visión y salidas JSON estructuradas.

- 🧠 Jamba 3B — Arquitectura híbrida Transformer-Mamba, alta eficiencia, 256K contexto.

- 🏢 Granite 4.0 Micro — IBM, orientado a empresas, RAG y function calling, licencia Apache 2.0.

- 💎 Phi-4 Mini — Microsoft, 3.8B params, datos sintéticos de alta calidad, 128K contexto.

💡 Explicación en pocas palabras

La cuantización “comprime” los modelos de IA reduciendo la precisión de los números (de 32 bits a 4 u 8 bits). Un modelo que necesitaría 16GB de RAM puede caber en los 4GB de una Raspberry Pi, con mínima pérdida de calidad. ¡IA en el borde, literalmente!

Más información en el link 👇

También publicado en LinkedIn.