🚀 7 modelos open‑source que están cambiando el AI coding#

Estos son modelos de IA open‑source para programar sin depender de servicios en la nube.

La idea central es simple: más privacidad, más control y cero costes por API.

Algunos puntos clave del artículo:

- 🔐 Privacidad total: tu código nunca sale de tu máquina.

- ⚡ Modelos potentes: desde razonamiento avanzado hasta agentes autónomos.

- 🧩 MoE y contextos enormes: ideales para flujos largos, debugging y tareas complejas.

- 💸 Ahorro: si ya tienes buen hardware, puedes evitar suscripciones caras.

🧠 Explicación en pocas palabras#

Imagina que en vez de enviar tu código a servidores externos (como cuando usas Copilot o Claude), pudieras tener un “mini‑Cerebro IA” funcionando localmente en tu ordenador.

Eso significa:

- Nadie ve tu código.

- Respuestas rápidas sin depender de internet.

- Puedes automatizar tareas largas sin límites.

Estos modelos open‑source permiten justamente eso: IA de alto nivel, pero en tu propio equipo.

🧩 Modelos y sus características principales#

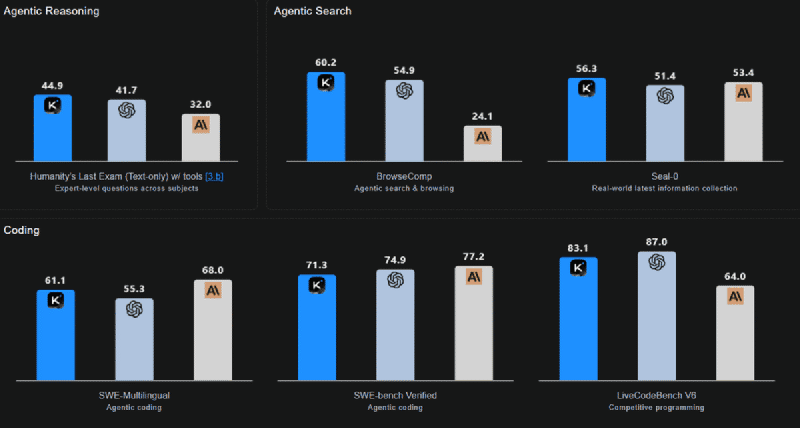

1. Kimi‑K2‑Thinking (Moonshot AI)#

- 🧠 MoE de 1T parámetros (32B activos)

- 🛠️ Agente con razonamiento paso a paso

- 🔁 Mantiene 200–300 llamadas a herramientas sin perder coherencia

- 📏 Contexto: 256K tokens

- ⚡ INT4 optimizado para baja latencia

- ⭐ Fuerte en razonamiento largo, multilingüe y workflows autónomos

2. MiniMax‑M2 (MiniMaxAI)#

- 🧩 MoE de 230B parámetros (10B activos)

- ⚡ Alta eficiencia y baja latencia

- 🔄 Ideal para ciclos plan → act → verify

- 🎯 Diseñado para agentes interactivos y tareas de código

- 💰 Optimizado para coste y velocidad

3. GPT‑OSS‑120B (OpenAI)#

- 🧠 117B parámetros, 5.1B activos

- 🔧 Herramientas nativas: function calling, browsing, Python, structured outputs

- 🎚️ Niveles configurables de razonamiento

- 🧪 Full fine‑tuning disponible

- 🥇 Alto rendimiento en competición, razonamiento y uso de herramientas

4. DeepSeek‑V3.2‑Exp (DeepSeek AI)#

- 🧠 671B parámetros, 37B activos

- 🧵 Introduce DeepSeek Sparse Attention (DSA)

- 📏 128K tokens de contexto

- 🎯 Optimizado para eficiencia en secuencias largas

- 🔬 Rendimiento similar a V3.1 pero con mejoras en eficiencia

5. GLM‑4.6 (Z.ai)#

- 🧠 355B parámetros, 32B activos

- 📏 Contexto ampliado a 200K tokens

- 💻 Mejoras claras en coding y generación front‑end

- 🔧 Mejor integración con agentes y herramientas

- 🥇 Competitivo frente a DeepSeek‑V3.1 y Claude Sonnet 4

6. Qwen3‑235B‑A22B‑Instruct‑2507 (Alibaba Cloud)#

- 🧠 235B parámetros, 256K tokens

- 🎯 Modelo no‑thinking: respuestas directas sin mostrar razonamiento

- 🌍 Fuerte en multilingüe, lógica, matemáticas y coding

- 🧰 Mejoras en tool‑use y alineación con preferencias del usuario

- 🏢 Ideal para tareas prácticas y producción

7. Apriel‑1.5‑15B‑Thinker (ServiceNow AI)#

- 🧠 15B parámetros (muy compacto)

- 👁️ Multimodal: texto + imágenes

- 📏 Contexto ~131K tokens

- ⚙️ Entrenamiento continuo en texto e imágenes

- 🏭 Excelente para agentes empresariales y DevOps

Más información en el link 👇

También publicado en LinkedIn.