🚀 Apache Airflow: orquestación de workflows para equipos de datos#

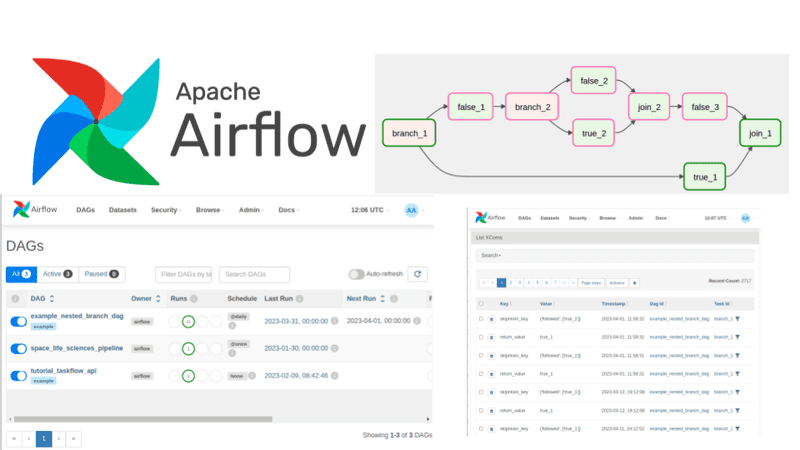

Apache Airflow es una plataforma open‑source que permite crear, programar y monitorear flujos de trabajo complejos usando solo Python. Ideal para pipelines de datos, machine learning, automatización y operaciones en la nube.

🔑 Puntos clave#

- 🧩 Escalable — arquitectura modular que coordina múltiples workers.

- 🐍 Pure Python — define tus pipelines como código, sin configuraciones crípticas.

- 🔄 Dinámico — genera tareas y DAGs de forma programática.

- 🧱 Extensible — crea tus propios operadores y conéctate a GCP, AWS, Azure y más.

- 🖥️ UI moderna — monitoreo claro, logs accesibles y gestión visual de tareas.

- 🌐 Open Source — comunidad activa, mejoras continuas y contribuciones abiertas.

🧠 Explicación en pocas palabras#

Imagina que tienes muchas tareas que deben ejecutarse en cierto orden: mover datos, entrenar un modelo, enviar un reporte, etc.

Airflow actúa como un director de orquesta:

- decide qué tarea va primero,

- controla cuándo se ejecuta,

- verifica si salió bien,

- y permite automatizar todo sin intervención manual.

Si sabes Python, puedes crear estos flujos como si escribieras cualquier script, pero con superpoderes para programarlos, monitorearlos y escalar.

Más información en el link 👇

También publicado en LinkedIn.